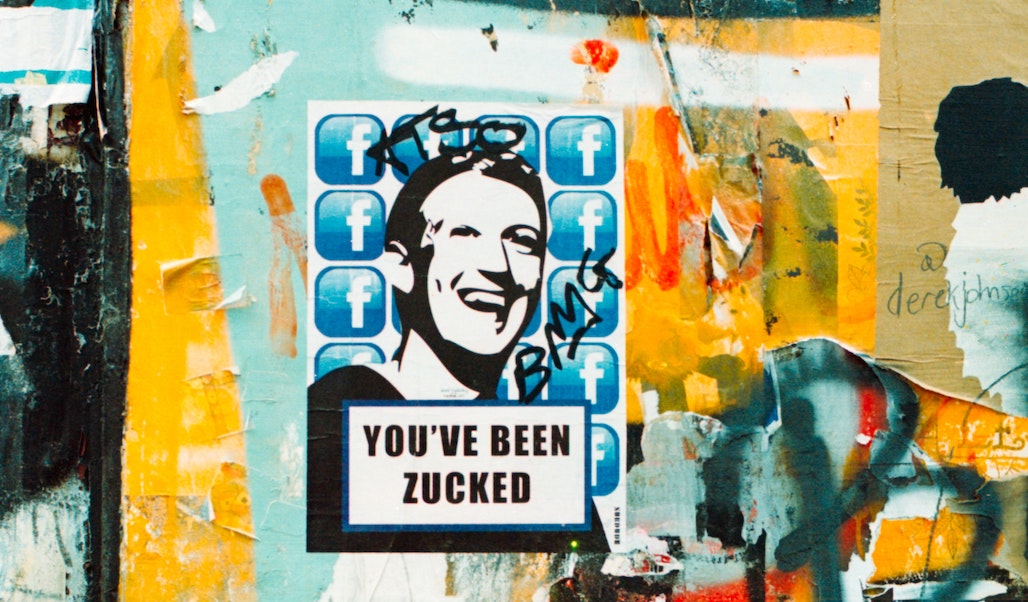

Rețele sociale: când oamenii nu-s acasă, boții moderează-n masă

Pe măsură ce pandemia de coronavirus a cuprins lumea, giganți precum Facebook, Google și Twitter au trimis angajații acasă. Printre ei s-au aflat și zeci de mii de oameni însărcinați cu parcurgea unor cantități enorme de conținut, pentru a elimina materialele ilegale, dăunătoare sau sexuale.

Pe măsură ce pandemia de coronavirus a cuprins lumea, giganți precum Facebook, Google și Twitter au trimis angajații acasă. Printre ei s-au aflat și zeci de mii de oameni însărcinați cu parcurgea unor cantități enorme de conținut, pentru a elimina materialele ilegale, dăunătoare sau sexuale, explică Politico. În locul lor, companiile au apelat la algoritmi (boți).

Mașinile, mai indulgente decât oamenii

S-a constatat că boții au lăsat să treacă mai mult conținut ilegal decât făceau oamenii. Facebook și Google aproape că și-au dublat cantitatea de material potențial dăunător pe care l-au eliminat în al doilea trimestru al acestui an, comparativ cu primul trimestru, potrivit rapoartelor companiilor (Twitter nu a furnizat încă cifre pentru 2020).

În Siria, unde militanții și jurnaliștii se bazează pe rețelele sociale pentru a documenta potențialele crime de război, zeci de conturi ale activiștilor au fost închise peste noapte, de multe ori fără drept de a contesta aceste decizii.

Alte conținuturi, inclusiv știri și informații despre sănătate legate de coronavirus, au fost eliminate de pe Internet pe măsură ce boții au început să funcționeze.

Dar o mulțime de postări discutabile au rămas neatinse. În Franța, militanții împotriva rasismului și antisemitismului au observat o creștere cu peste 40% a discursului de ură pe Twitter. Mai puțin de 12% dintre aceste postări au fost eliminate.

Confruntarea cu urâțeniile Internetului

Înainte ca pandemia să-i forțeze pe giganții tehnologici să-și trimită acasă moderatorii de conținut, mai mult de 30.000 de persoane, de cele mai multe ori angajați cu salariu mic din Berlin și Austin, Texas, petreceau ore întregi uitându-se la unele dintre cele mai groaznice materiale postate de utilizatori. Facebook, Google și Twitter, aproape la unison, și-au anunțat trecerea la automatizare la mijlocul lunii martie.

Moderatorii de conținut de pe rețelele de socializare analizează mii de postări explicite în fiecare zi și nu primesc niciun sprijin psihic pentru a gestiona impactul confruntării cu acele imagini dure. Deciziile lor sunt apoi introduse în instrumentele de învățare automată ale companiilor, care necesită seturi mari de date ca să-și rafineze deciziile de eliminare.

Cele trei companii au spus inițial că moderatorii de conținut nu ar putea lucra de acasă, din cauza îngrijorărilor cu privire la prelucrarea datelor persoane. Cu toate acestea, Facebook permite acum unor moderatori să revizuiască materialele de la distanță, cu excepția celor mai explicite. Google a spus că va urma exemplul, dar nu a oferit detalii.

Crește negativitatea din social media

YouTube a eliminat 11,4 milioane de videoclipuri în al doilea trimestru, comparativ cu 6 milioane de videoclipuri în perioada ianuarie – martie. Numărul de contestații admise (atunci când creatorii de conținut au consderat că videoclipurile lor au fost șterse fără motiv) a crescut de asemenea de patru ori, la 160.000 de videoclipuri, în aceeași perioadă.

Facebook a raportat cifre similare: numărul de eliminări marcate ca discurs de ură aproape că s-a dublat față de ianuarie – martie, ajungând la 22,5 milioane de postări în al doilea trimestru al anului 2020. Creșterea s-a datorat și faptului că Facebook și-a extins instrumentele de moderare a conținutului la postări care nu sunt în limba engleză.

Facebook recrutează cenzori din China

Cum se cenzurează la Facebook? Sistemul ia tot ce postează utilizatorii și aruncă acel conținut într-un algoritm de învățare automată și rețele neuronale, care determină clasarea articolelor. Inginerii Facebook testează sute de iterații diferite ale categoriilor, pentru a obține un rezultat optim. Acesta este probabil cel mai înfiorător mecanism de cenzură din istoria omenirii.

În China, nivelul de cenzură este unul dintre cele mai ridicate din lume. Așa că Facebook s-a îndreptat spre această zonă pentru a-și recruta cenzorii pentru platforma socială, scrie Politico.

La departamentul Hate-Speech Engineering, lucrătorii au doctorate, iar munca lor este extrem de complexă, implicând machine learning, adică învățarea computerelor despre cum să acționeze autonom. Printre alți specialiști chinezi angajați la Facebook, personalul departamentului include în biroul din Seattle un om de știință care și-a luat masterul în inginerie informatică la Academia Chineză de Științe din Beijing.

O mulțime de firme Big Tech își recrutează specialiștii străini din China, India și din alte părți, iar mulți dintre acești muncitori speră să se stabilească permanent în Statele Unite.

Foto: Annie Spratt (Unsplash)

Articole asemănătoare

Influencerii și politicienii contribuie la propagarea dezinformării privind coronavirusul

Spotify dezvăluie cât de popular este podcastul lui Joe Rogan

„Un război pentru mințile oamenilor”. Cum arăta strategia de propagandă internă a Rusiei

Andi Manciu și-a anunțat plecarea de la vârful Grupului de Comunicare Strategică

UE introduce legi dure cu privire la conținutul platformelor Big Tech